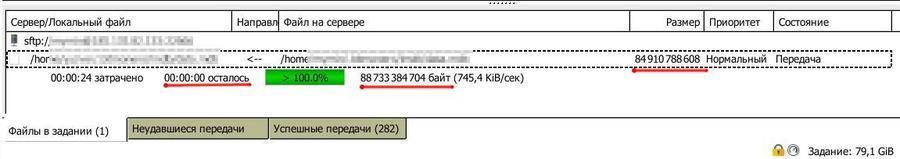

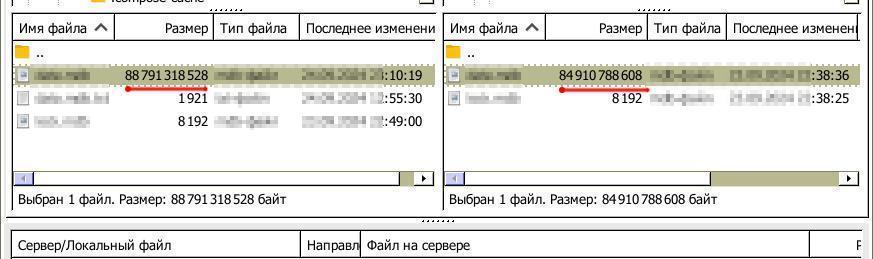

Сутки скачивался файл Беркли ДБ исходным размером 84 910 788 608 байт (80G), но в итоге накачало (падлюка) 88 791 318 528 байт (83G) и останавливаться не собиралось, и - это вряд ли тот случай когда больше значит лучше...

Сутки скачивался файл Беркли ДБ исходным размером 84 910 788 608 байт (80G), но в итоге накачало (падлюка) 88 791 318 528 байт (83G) и останавливаться не собиралось, и - это вряд ли тот случай когда больше значит лучше...

On source: # du -shc /PATH/FILE/SRC 80G /PATH/FILE/SRC 80G total On target: $ du -shc /PATH/FILE/DST 83G /PATH/FILE/DST 83G итого

Вместо 80 ГБ накачало 83 и продолжало сука качать дальше:

Скачивание файла несколько раз приостанавливалось для освобождения сетевого канала под иные нужды.

Сначала скачивания файл не изменялся, ни в размере ни по дате модификации, но достижение предельного размера 84 910 788 608 байт (80G) не остановило FileZilla и скачивание продолжилось:

Это безобразие было остановлено вручную.

Так... Предвижу.., что сейчас изо всех аналов попрут кверху знатоки-эксперты со своими ФАКами про:

- неправильные режимы передачи в настройках FileZilla;

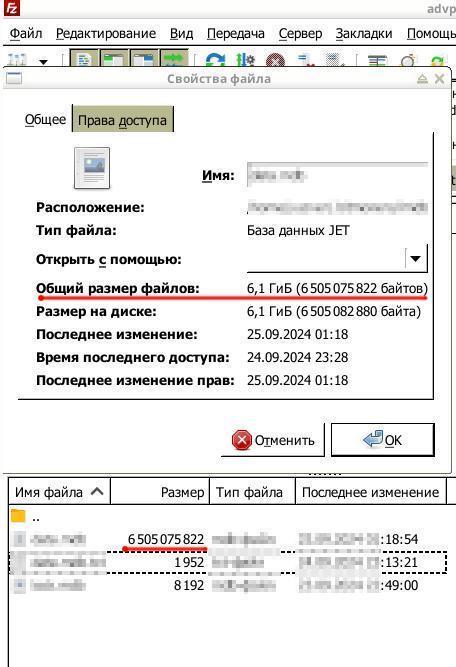

- разницу в размерах кластеров (Общий размер и Размер на диске);

- и прочую...

Однако:

- В настройках передачи была выбрана опция Докачать.

- Тип передачи: Двоичный (бинарный тобишь). Файл Беркли ДБ так точно не ASCII.

- В настройках FileZilla (Передачи - Действие, если файл существует) анонсированы проблемы только с докачкой текстовых ASCII файлов, про проблемы с докачкой в бинарном/двоичном режиме никак и нигде не упоминается

- Общий размер файла (НЕ Размер на диске) FileZilla, ФМ и команда ls на обоих концах (DST <--> SRC) - определяют верно:

Кстати говоря ФС/размеры кластеров/ОС Linux на обоих концах одинаковые, а размеры кластеров на дисках точно до сракы потому, что в FileZilla и выводах команд du | ls отображается Общий размер, т.е. точный до байта размер файла, а не Размер на диске, на который размер кластера влияет!

Значит.., - проблема точно не с типом передачи или размером кластеров.

Точняк лыжи не едут

- сука поламатые!

Файл был расшарен сим-линками и успешно скачан wget-от через веб-сервер с приостановкой и докачкой (флаг -c):

$ wget -c http://xxx.xxx.xxx.xxx/big_file --2024-09-25 08:51:09-- http://xxx.xxx.xxx.xxx/big_file Подключение к xxx.xxx.xxx.xxx:80... 08:51:09 ... соединение установлено. HTTP-запрос отправлен. Ожидание ответа… 206 Partial Content Длина: 84910788608 (79G), 54613771633 (51G) осталось [application/msaccess] Сохранение в: «big_file» big_file 100%[+++++++++++++++++++...==============>] 79,08G 1,07MB/s за 18h 4m 2024-09-26 02:55:57 (820 KB/s) - «big_file» сохранён [84910788608/84910788608]

md5sum снятые с big_file на удалённом сервере и с локально скачанной wget копии - сошлись!

Очевидно, FileZilla подходит для небольших файлов, на крупных 80ти гиговых подглюкивает.

P.S. Что ж это оно всё вокруг так глючит то зараза?! Это же какой бляха глюкодром то начнётся, когда сатанисты-чипукизаторы шировурдалаки-зомбокцинаторы всем вокруг ещё в башку и мозговые чипы повтыкают, - ото будет..!