В прошлом месяце сообщалось о группе сотрудников Google из подразделения Machine Perception, обучивших систему на основе глубоких нейронных сетей профессиональной обработке фотографий.

В прошлом месяце сообщалось о группе сотрудников Google из подразделения Machine Perception, обучивших систему на основе глубоких нейронных сетей профессиональной обработке фотографий.

Еще тогда высказывались предположения, что Google с высокой долей вероятности не оставит эту перспективную идею и реализует в каком-нибудь продукте. Теперь же стало известно, что специалисты Google совместно с коллегами из Лаборатории информационных технологий и искусственного интеллекта MIT занялись разработкой системы, которая сможет моментально обрабатывать фотографии «в стиле профессиональных фотографов», снятые на камеру смартфона. Исследование опубликовано в журнале ACM Transactions on Graphics, кратко о ней рассказывает пресс-служба института.

Как сообщается, технология не просто позволит качественно обрабатывать фотографии, обеспечивая результат, сопоставимый с тем, если бы этим занимался профессиональный фотограф. Обработка будет происходить в реальном времени. То есть, пользователь сможет увидеть итоговый результат еще до получения готовой фотографии, в момент ее захвата.

«Фотографии, которые снимают современные камеры, зачастую воспринимаются как сырой материал. Прежде чем поделиться снимком в соцсетях даже те, кто снимают на смартфон, тратят минуту или две, выравнивая цвет и контраст с помощью популярных фоторедакторов», – отмечают в MIT.

Их разработка призвана вывести обработку на новый более высокий уровень, одновременно сделав сам процесс удобнее.

Google уже некоторое время использует систему HDR+, которая делает несколько снимков с разной экспозицией и объединяет их, помогая убрать слишком светлые и слишком темные области, но она работает уже с готовой фотографией. К тому же, в данном случае требуется делать несколько кадров подряд.

В основе нового алгоритма лежит сверточная нейросеть. Вычислительная мощность современных мобильных устройств недостаточно высока для полноценной работы системы, но исследователи сумели обойти это ограничение – система выполняет большую часть вычислений на уменьшенной копии исходного изображения, а затем переносит результаты на фотографию в высоком разрешении.

Для обучения алгоритма профессиональной обработке использовался набор из пяти тысяч пар фотографий: исходных и отретушированных профессиональными фотографами. После тренировок исследователи протестировали программу на обычном смартфоне (модель не указывается), и алгоритм смог в реальном времени выдавать на экран обработанное изображение с разрешением 1920×1080 пикселей и частотой обновления в 40–50 Гц.

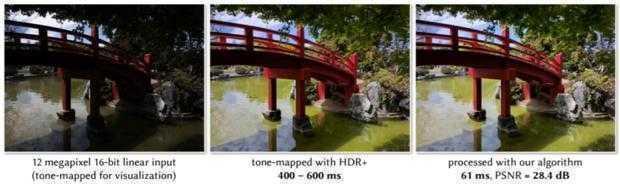

Изображение ниже позволяет наглядно оценить возможности нового алгоритма:

Слева – оригинал 12-мегапиксельной фотографии, справа – та же фотография, сделанная новым алгоритмом. Фото MIT

Слева – оригинал 12-мегапиксельной фотографии, справа – та же фотография, сделанная новым алгоритмом. Фото MIT

Еще пример, правда размер изображения не позволяет полноценно оценить возможности системы:

Сравнение обработки 12-мегапиксельного изображения с помощью существующего алгоритма HDR+ и новой разработки.

Сравнение обработки 12-мегапиксельного изображения с помощью существующего алгоритма HDR+ и новой разработки.

Когда данная технология найдет применение в серийном продукте и станет доступна всем желающим, точно неизвестно. Разработчики утверждают, что это может произойти в обозримом будущем. Возможно технология подоспеет как раз к выходу новых смартфонов Google Pixel?